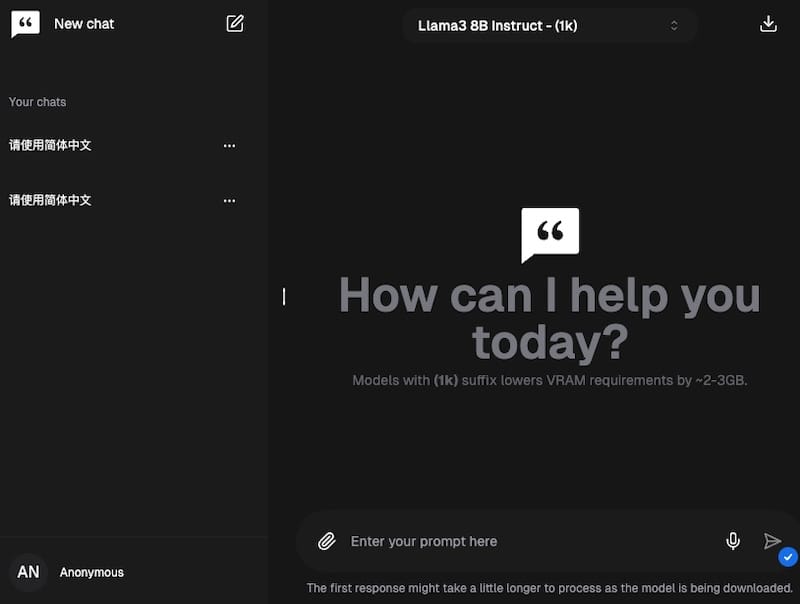

Chatty(浏览器上运行的本地大模型AI聊天工具)简介

Chatty是一个浏览器上运行的本地大模型AI聊天工具,是一个利用WebGPU在浏览器中本地和私密地运行LLM的Next.js应用程序,这种方式消除了对服务器端处理的需求,确保数据仅保留在本地计算机上,不会通过互联网传输。,从而实现将LLM的强大功能植入到浏览器,同时确保完全的隐私和离线功能。

该工具支持流行的开源模型,如Gemma、Llama2、Llama3和Mistral。让我们能够使用各种前沿的AI技术,同时该同居不仅仅是一个私人AI聊天工具,它提供了大量功能来增强我们的使用体验。受到Gemini和ChatGPT等知名AI界面的启发,该工具也拥有类似的直观的用户界面,为用户提供了熟悉的使用方式。

该工具还有一个功能特性就是能够通过XenovaTransformerEmbeddings和MemoryVectorStore处理和理解文件,包括PDF和非二进制文档。这样我们就可以上传文件,并就内容向AI模型提问,同时我们的文档将完全保留在本地,确保数据和隐私安全。

该工具还允许您添加自定义指令和记忆,使AI能够提供更个性化和有针对性的响应。另外还可以将聊天记录导出为JSON或Markdown格式,方便保存和共享对话内容。

该工具提供了语音输入支持,允许我们使用自然语音与模型进行交互。如果您对响应不满意,也可以快速重新生成,而无需重新输入提示。

Chatty(浏览器上运行的本地大模型AI聊天工具)官网

如果要在本地设置和运行项目,请按照以下步骤操作:

1.通过命令提示符将存储库克隆到PC上的目录:

git clone https://github.com/addyosmani/chatty

2. 打开文件夹:

cd chatty

3. 安装依赖:

npm install

4. 启动开发服务器:

npm run dev

5. 浏览器中打开 localhost:3000 并开始聊天!