OpenAI 在今天的春季发布活动中,宣布推出最新发布的 GPT-4o Model,当中 (“o”代表“omni”)这标志着在更自然和多样化的人机互动方面取得了重大进展。

反应速度更快

GPT-4o的一个突出特点是其对音频输入的快速反应时间。它可以在仅232毫秒内做出回应,平均反应时间为320毫秒,这与人类的对话速度非常接近。这一改进使得GPT-4o成为现有模型中更高效的替代品,提供更快且更具成本效益的性能。具体来说,它在英语文本和编码方面达到了GPT-4 Turbo 的水准,在非英语语言方面表现出色,并且处理请求的成本显著降低——通过API便宜50%。

声画处理能力提升

GPT-4o在视觉和音频理解方面的进步尤其值得注意。之前的模型,如使用 Voice Mode 的 GPT-3.5 和 GPT-4,处理音频输入需要多步骤过程,导致更高的延迟(GPT-3.5为2.8秒,GPT-4为5.4秒)且丢失了很多上下文信息。这些模型使用单独的系统来将音频转录为文本、处理文本以及将文本转换回音频,这限制了它们识别语气、处理多个讲话者或解释背景噪音的能力。

即时语音对话功能

GPT-4o 不仅提供与 GPT-4 相当的智能水平,还在速度和功能上有所提升。例如,用户现可将不同语言的餐牌拍照后,直接与 GPT-4o 交谈来翻译并了解食物的历史与重要性,同时获得餐点建议。OpenAI 预计在未来引入更自然的即时语音对话功能,并能通过实时视频与 ChatGPT 互动,如解说直播体育赛事的规则等。

支持超过 50 种语言

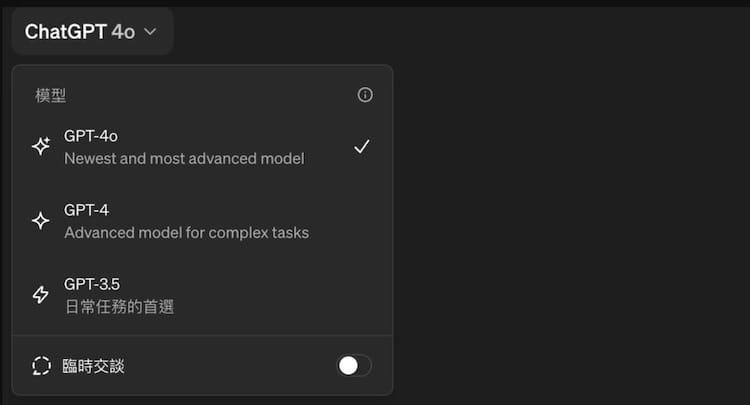

GPT-4o 的语言处理能力在质量和速度上均有显著提高,现支持超过 50 种语言。OpenAI 已开始将 GPT-4o 推广至 ChatGPT Plus 和 Team 使用者,企业用户也将很快获得服务。此外,GPT-4o 也已对所有用户开放,但免费用户将受到使用限制,其中 Plus 用户的消息限制是免费用户的 5 倍,Team 和企业用户则有更高的限制。

OpenAI 的使命包括为更多人提供先进的 AI 工具。目前,每周已有超过一亿人使用 ChatGPT。未来几周,OpenAI 将逐步为免费用户提供更多智能工具和功能,这包括使用 GPT-4o 享受 GPT-4 级的智能体验、获得模型和网络的回应、进行数据分析和创建图表、讨论照片内容、上传文件以获得摘要、写作或分析的协助、探索和使用 GPTs 以及 GPT Store,以及利用记忆功能打造更为贴心的使用体验。